Sin duda alguna, esta es una de las mas difíciles comentarios que me ha tocado escribir, Los BAYESIANOS, son aquellos que pertenecen a una Orden de la EstaDIOStica y que profesan la Estadística Bayesiana , y aunque es de lo más interesante del mundo este tipo de estadística es muy poco entendida debido principalmente al grado de dificultad que presenta y a que los FRECUENCISTAS, que es el nombre correcto de la estadística que comúnmente manejamos, han acaparado toda o casi toda nuestra atención.

Su Patrono e iniciador es Thomas Bayes a principios del siglo 18 y curiosamente el si era un hombre religioso, era Ministro Presbiteriano. Ver su biografía http://es.wikipedia.org/wiki/Thomas_Bayes.

Los Bayesianos son más bien una orden del tipo contemplativo, es decir son estudiosos de la Estadística, y nunca se ha visto uno en un piso de producción, los Bayesianos puros están recluidos en sus mazmorras monásticas, léase Universidades. Son excelentes Matemáticos y programadores de algoritmos, tengo el gusto de contar con un amigo Bayesiano cuyo nombre es Ioannis Ntzoufras que es profesor del departamento de estadística de la Universidad de Atenas y aunque lo conocí por internet me ayudo muchísimo explicándome algunos conceptos. Lo que si es que ellos consideran que la Estadística Bayesiana es superior a la estadística Frecuencista.

Ya comentaremos características y según yo Ventajas y desventajas.

En toda mi carrera solo he sabido de 2 personas en la Industria que manejen medianamente bien la Inferencia Bayesiana (Al rato explicamos el concepto), y que pudieron aplicar el concepto en algún proyecto real en una maquiladora o proceso productivo; una amiga llamada Rocío, que se graduó de Licenciada en Estadística de la Universidad de Veracruz y aquí su Charro Negro; y debo ser honesto ,me llevo más de un año solamente entender el concepto y poder programar un modelo adecuado, y lo que les puedo comentar es que es impresionante la información se puede generar usando esta herramienta, información que me fue Imposible calcular usando Estadística convencional.

En la Estadística Bayesiana se interpreta el concepto de probabilidad como una “Medida de la creencia de que un evento va a suceder” cuando por otro lado la Estadística convencional la probabilidad se interpreta como una “FRECUENCIA” o propiedad física del sistema.

Aquí les va un ejemplo de cómo funciona la Estadística Bayesiana, y esta se basa en INFERIR de una Hipótesis dada de tal forma que se le asigna una probabilidad como medida de credibilidad de las hipótesis. Aquí les van un par de ejemplos.

“Durante miles de millones de años, el sol ha salido después de haberse puesto. El sol se ha puesto esta noche. Hay una probabilidad muy alta (o 'Yo creo firmemente que' o 'es verdad que') el sol va a volver a salir mañana. Existe una probabilidad muy baja (o 'yo no creo de ningún modo que' o 'es falso que') el sol no salga mañana”

•EL lunes llovió, el martes llovió, el miércoles llovió y el jueves llovió, luego entonces existe una alta probabilidad de que hoy viernes llueva”.

Probabilidad Condicional, cual es la probabilidad de que algo suceda si ya algo sucedió.

Como ven funciona muy semejante a una Regresión o más bien un Pronóstico y que la información anterior o A PRIORI sirve para “INFERIR” la probabilidad de un evento posterior o POSTERIORI.

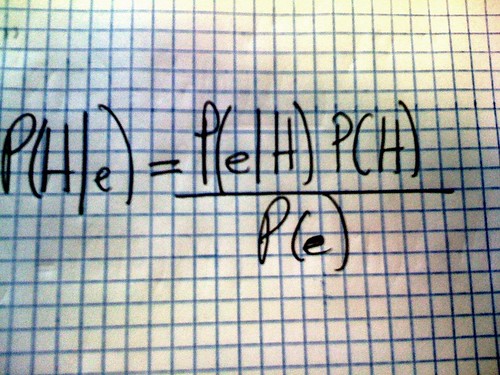

Más formalmente:

Donde:

• H0 representa una hipótesis, llamada hipótesis nula, que ha sido inferida antes de que la nueva evidencia, E, resultara disponible.

• P(H0) se llama la probabilidad a priori de H0.

• P(E H0) se llama la probabilidad condicional de que se cumpla la evidencia E dado que la hipótesis H0 es verdadera. Se llama también la función de verosimilitud cuando se expresa como una función de E dado H0.

• P(E) se llama la probabilidad marginal de E: la probabilidad de observar la nueva evidencia E bajo todas las hipótesis mutuamente excluyentes. Se la puede calcular como la suma del producto de todas las hipótesis mutuamente excluyentes por las correspondientes probabilidades condicionales.

• P(H0 E) se llama la probabilidad a posteriori de H0 dado E.

La forma en la cual se trabaja con l Inferencia Bayesiana es desarrollar un MODELO, algo asi como una regresión múltiple en donde hay que calcular las constantes y se utilizan métodos computacionales para calcular dichos valores., En el caso de la Inferencia bayesiana se crea el modelo y se utiliza un algoritmo conocido como MCMC Montecarlo + Cadena de Markov y más específicamente MUESTREO DE GIBBS para calcular los valores de las constantes, estos son algoritmos computacionales parecidos a los algoritmos de optimización. No se pierdan, estos algoritmos es el equivalente a calcular las constantes de una regresión usando MINITAB, Statistica, STATA u algún otro, aquí los software más comunes son el WINBUGS y un lenguaje de programación de estadística conocido como “R”.

Hablemos ahora de las Ventajas

La gran ventaja de la Inferencia Bayesiana contra la regresión múltiple podría ser que la regresión te da una fórmula que calcula un valor aproximado dependiendo de las variable de entrada, esto significa que te da la MEDIA calculada y se espera que tenga un comportamiento NORMAL, mientras que la inferencia bayesiana, te da no un valor sino un PARAMETRO, es decir te da la media, varianza o algún otro termino sin estar restringido a que sea Normal, imagínate una regresión Poisson, o Weibull o exponencial o SKellam y que la formula te calcule la media sino cualquier parámetro que desees.

Otra gran ventaja es que el modelo no tiene porque estar restringido a un polinomio lineal de primer orden, puede ser de cualquier orden e inclusive no lineal, todo depende del gusto del cliente.

Ya para terminar una ventaja que creo que será decisiva en el futuro es que la Inferencia bayesiana puede utilizar una gran cantidad de datos para crear sus modelos, esto es importante ya que actualmente con nuestros procesos tan automatizados y guardan electrónicamente millones de datos que contiene información sobre el procesos, son experimentos continuos y podemos usar estos datos para hacer nuestros análisis en vez de desarrollar diseños de experimentos para los cuales hay que parar el proceso y hacer experimentos específicos con valores de entrada preestablecidos, el futuro de la estadística esta mas bien en le MINERIA DE DATOS que de los DOE.

Los paquetes como WINBUGS y R son públicos y no tienen costo a diferencia del MINITAB, Statistica y similares.

Desventajas:

Mucho me temo que debido a su complejidad pocos de nuestros ingenieros serán capaces de dominar el tema.

Poca información sobre el tema, yo nunca he visto un curso acerca de Estadística Bayesiana específicamente dedicada para la industria.

Conclusión:

La tendencia a utilizar técnicas de MINERIA DE DATOS en vez de DOE impulsara el uso de la Estadística Bayesiana y otras técnicas que traten con una gran cantidad de datos, como los que tenemos en nuestras Bases de datos, la necesidad de información de modelos No lineales más completos y no de modelos súper simplificados como los que nos da un DOE convencional y donde sea rentable utilizarlos. Y es ahí justamente donde los Bayesianos se destacan y donde es más común encontrar sus trabajos, en áreas como Pronósticos Financieros, Todo lo que tiene que ver con Bolsa de valores, acciones, derivados, futuros , exóticos etc.

Otra área es en las aseguradoras, los actuarios están utilizando muchísimo esta técnica y probablemente el área en la industria donde se está usando mas es en el MANTENIMIENTO donde existen paquetes computacionales que funcionan como sistemas expertos en mantenimiento basados en algo conocido como REDES BAYESIANAS.

Cada vez es más común encontrar expertos en estadística y matemáticas como asesores permanentes en áreas productivas, algo así como Papa Pitufo, o como los MENTAT de Dunas, asi que en mi opinión, lentamente pero avanzando cada vez veremos mas y mas este tipo de herramientas en nuestras plantas.

Libros:

BAYESIAN DATA ANALYSIS (Tengo uno de mas por si a alguien le interesa)

LEARNING BAYESIAN NETWORKS

BAYESIAN MODELING USING WINBUGS

BAYESIAN COMPUTATION WITH R

MARKOV CHAIS, GIBBS FIELDS, MONTECARLO SIMULATION AND QUEUES

MARKOV CHAIN MONTECARLO IN PRACTICE

FINITE MARKOV CHAIN AND ALGORITHMIC

Links

3 comments:

post impresionante. Realmente disfruté la lectura de su blog.

Realmente blog informativo aquí mi amigo. Sólo quería hacer un comentario y decir que mantener el trabajo de calidad. He marcado tu ahora y voy a volver a leer más en el futuro de mi amigo! También bien elegidos los colores sobre el tema que va bien con el blog en mi modesta opinión:)

Esto realmente resuelto mi problema, gracias!

Post a Comment